Description détaillée du projet

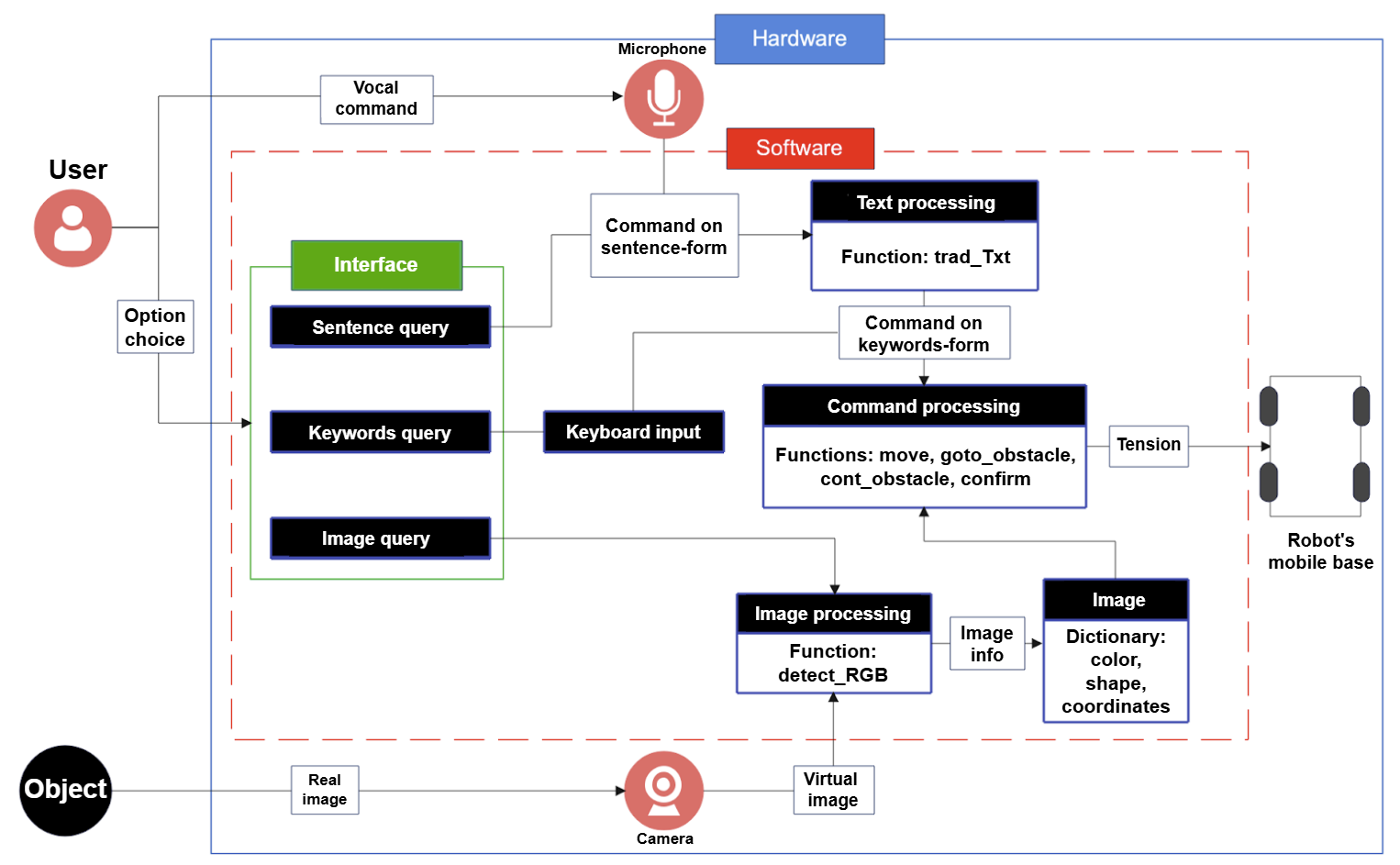

Ce projet se concentre sur le développement d'un robot virtuel capable d'analyser des images pour détecter des objets, comprendre des commandes textuelles en plusieurs langues et simuler des mouvements en fonction de ces instructions.

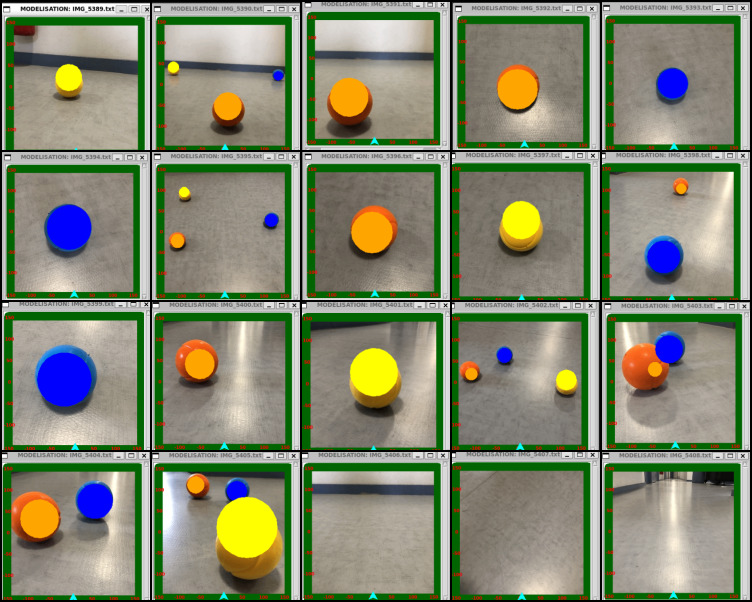

Traite les images d'entrée en détectant des balles de différentes couleurs et retourne les coordonnées de leur centre, leur couleur, leur diamètre et leur centre

Traite les ordres vocaux des utilisateurs qui peuvent les émettre tant en français qu'en espagnol.

Simule avec Turtle les mouvements du robot dans un environnement réel, basé sur l'image et les ordres d'entrée

Cette phase est une base préparatoire pour son implémentation dans un robot physique à l'avenir.

Utilisation

- 1- git clone https://github.com/IsmaTIBU/MobotSim

- 2- cd mobot

- 3- make (pour compiler le projet)

- 4- ./main (pour l'exécuter)

Réalisations

- Système de commandes vocales classé comme le meilleur de la promotion par un jury composé de professionnels dans ce domaine particulier.

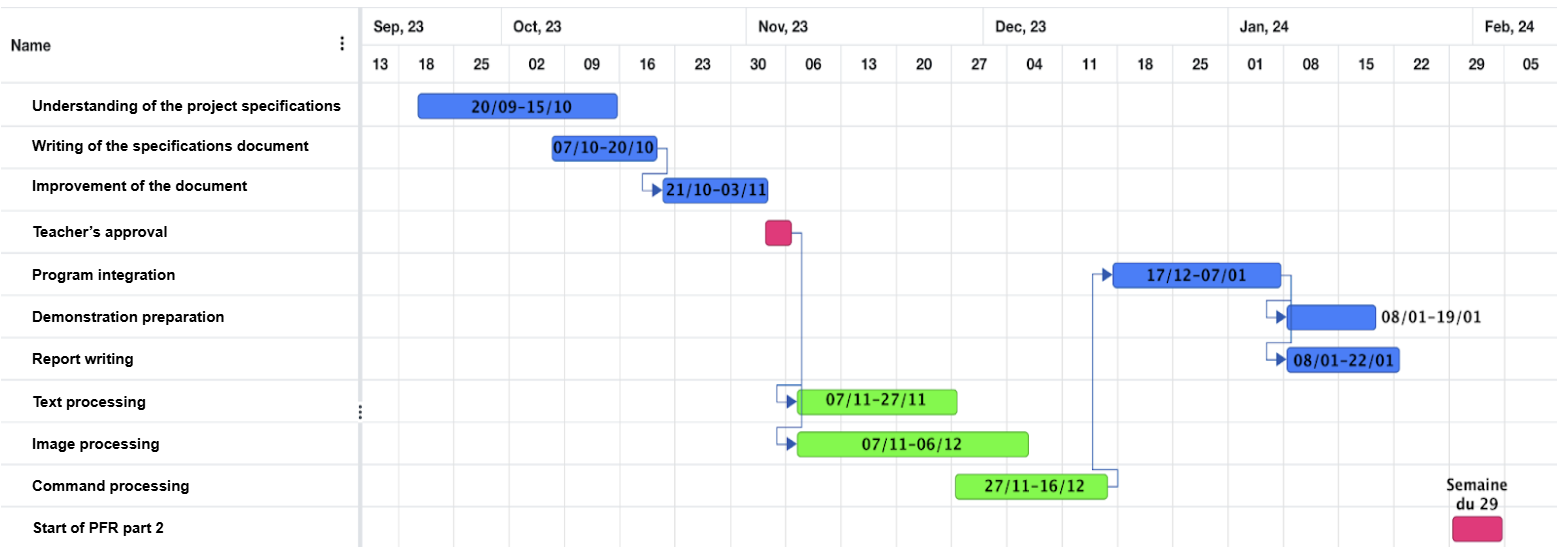

- Reconnus pour être les seuls à respecter rigoureusement les délais de livraison établis à chaque phase du projet

- Détection d'objets multiples avec 90% de précision en diamètre/position

- Système de commandes adaptable aux phrases complexes et unités variables

- Simulation fluide avec retour visuel, validant la logique pour une future implémentation en matériel réel